Hör mal, wer da spricht

Schon im Mutterleib erkennen Kinder Sprachmelodien. Frisch auf der Welt nutzen sie alle Sinne, um das Sprechen zu lernen. Doch der Weg zur eigenen Sprache ist lang. Er wird meist dann gut gemeistert, wenn Erwachsene geduldig unterstützen.

Wissenschaftliche Betreuung: Prof. Dr. Ferdinand C. Binkofski

Veröffentlicht: 29.04.2015

Niveau: mittel

- Kinder lernen schon im Mutterleib, bestimmte Sprachklänge und Stimmen zu unterscheiden.

- Dieses Gespür für die Sprachmelodie (Prosodie) verfeinert sich nach der Geburt sowohl beim Lautverständnis der Babys als auch in ihrem Gebrabbel.

- Im zweiten Halbjahr beginnen Kinder auch die inhaltliche Bedeutung bestimmter Laute (Semantik) zu verstehen und sprechen einige Monate vor oder nach dem ersten Geburtstag das erste Wort.

- Erst im zweiten und dritten Lebensjahr entwickelt sich die Fähigkeit, Worte sinnvoll anzuordnen (Syntax).

- Die Interaktion zwischen dem Kind und seinen Bezugspersonen spielt die entscheidende Rolle. Kinder reagieren sensibel auf Melodie und Kontext der sie erreichenden Kommunikation. Erwachsene wiederum passen ihre Sprache an Kinder an, um sie besonders verständlich zu machen.

- Auch das Sehen spielt eine große Rolle beim Sprechen lernen. Babys achten sowohl auf Lippenbewegungen als auch auf Gesten.

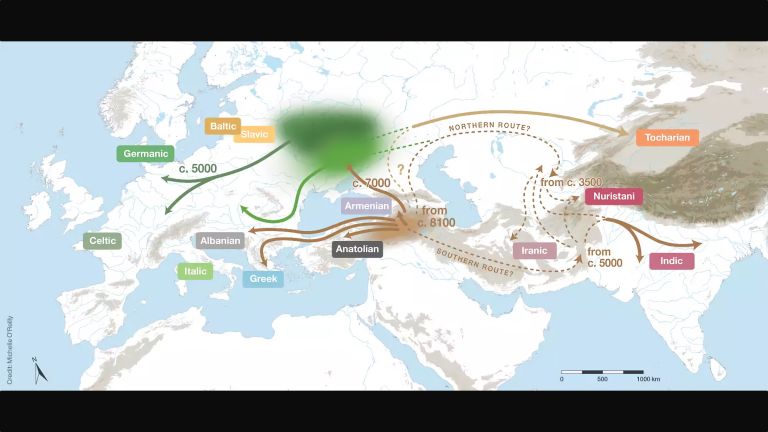

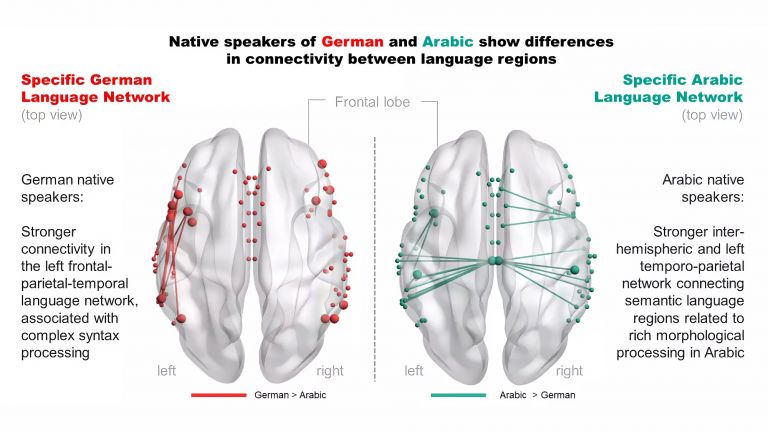

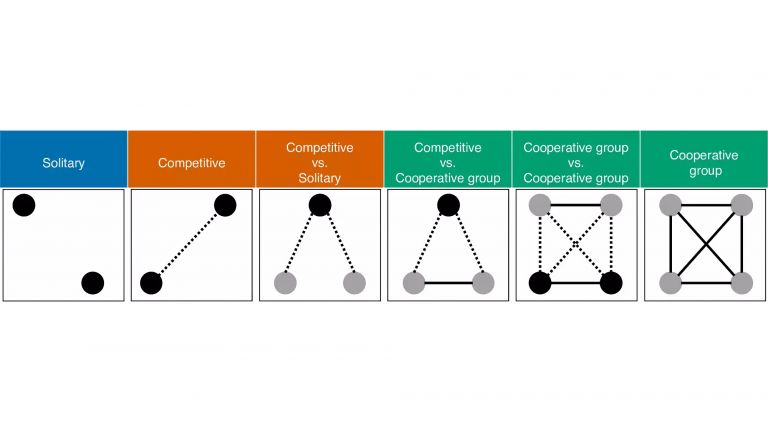

Früher galt zweisprachige Erziehung als bedenklich; groß war die Sorge vor Verwirrung, sprachlichen Verzögerungen oder gar einer dauerhaften Unfähigkeit, auch nur eine der Muttersprachen „richtig“ zu erlernen. Inzwischen hat sich das Bild gründlich gewandelt. Bilingualität liegt voll im Trend – und das nicht ganz ohne Grund. Zweisprachig aufwachsende Kinder haben ein feineres Gehör für Sprachen und können besser multitasken. Weil bilingual erzogene Kinder von Anfang an mit mehr Vokabeln und unterschiedlichen grammatischen Regelsystemen klarkommen müssen, üben sie sich früh in geistiger Flexibilität und schnellen Schaltübungen zwischen unterschiedlichen Anforderungen. Als Folge sind ihre so genannten exekutiven Funktionen, die Menschen dabei helfen, sich auf das jeweils Wesentliche zu konzentrieren, besser ausgebildet. Schließlich lernt das bilingual denkende Kind schon jung, eine der ständig um seine Aufmerksamkeit wetteifernden Sprachen selektiv in den Hintergrund zu drängen. Wer nicht bilingual aufgewachsen ist, braucht sich jedoch nicht benachteiligt zu fühlen. Auch das Erlernen einer Fremdsprache später im Leben kann ähnlich angenehme kognitive Nebenwirkungen mit sich bringen. So bleiben bilinguale Menschen im Alter zum Beispiel länger geistig fit als einsprachige Personen – auch wenn sie die Zweitsprache erst als Erwachsene erlernt haben.

Aufmerksamkeit

Aufmerksamkeit/-/attention

Aufmerksamkeit dient uns als Werkzeug, innere und äußere Reize bewusst wahrzunehmen. Dies gelingt uns, indem wir unsere mentalen Ressourcen auf eine begrenzte Anzahl von Reizen bzw. Informationen konzentrieren. Während manche Stimuli automatisch unsere Aufmerksamkeit auf sich ziehen, können wir andere kontrolliert auswählen. Unbewusst verarbeitet das Gehirn immer auch Reize, die gerade nicht im Zentrum unserer Aufmerksamkeit stehen.

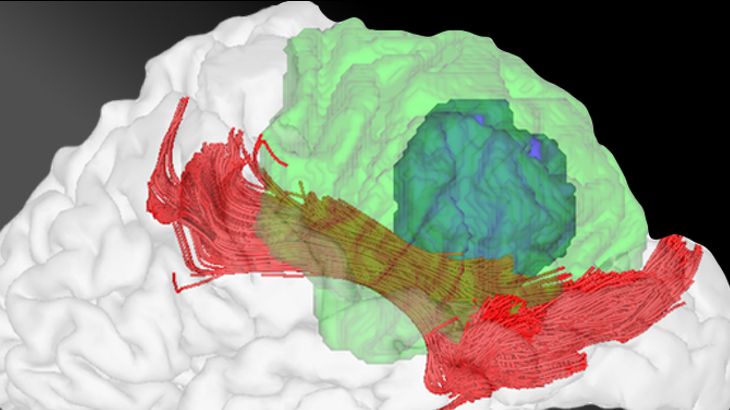

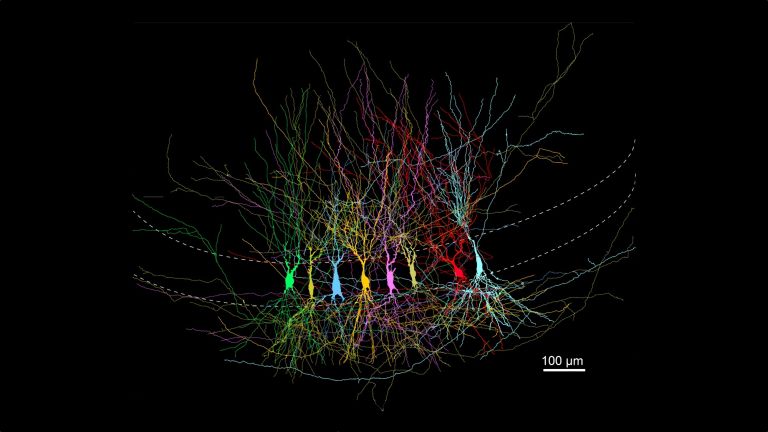

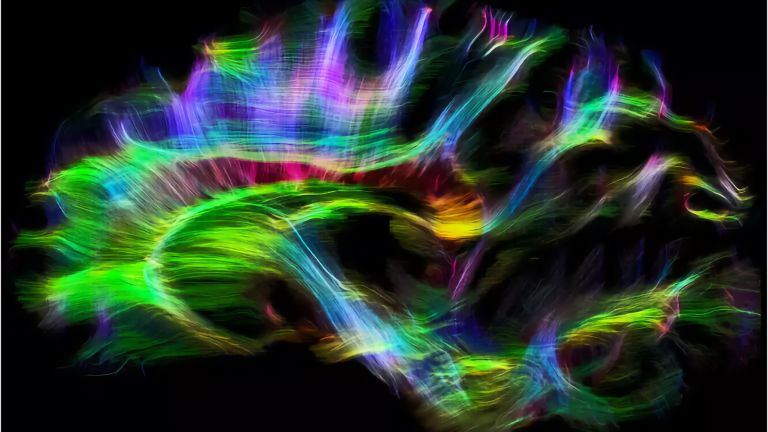

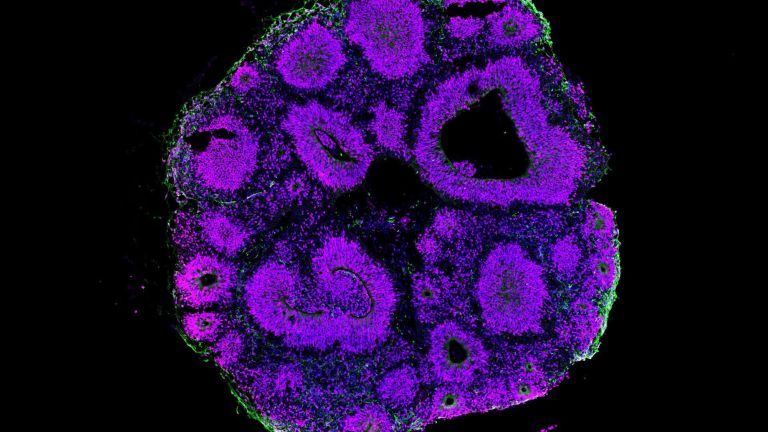

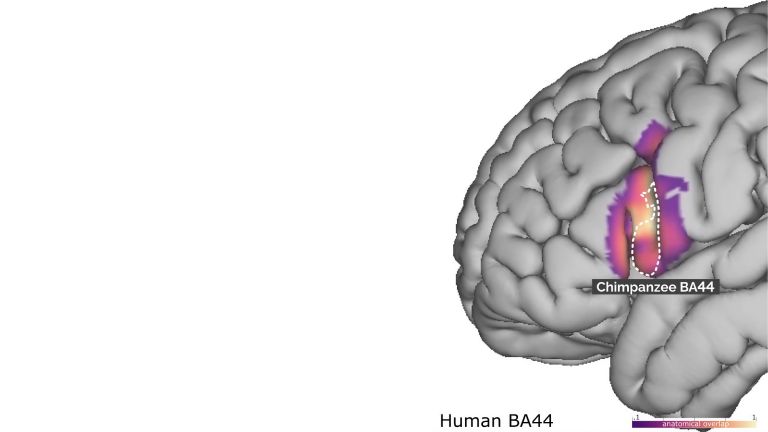

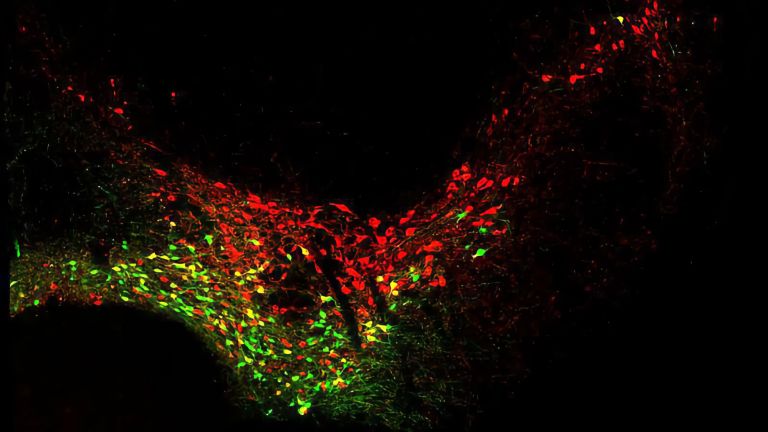

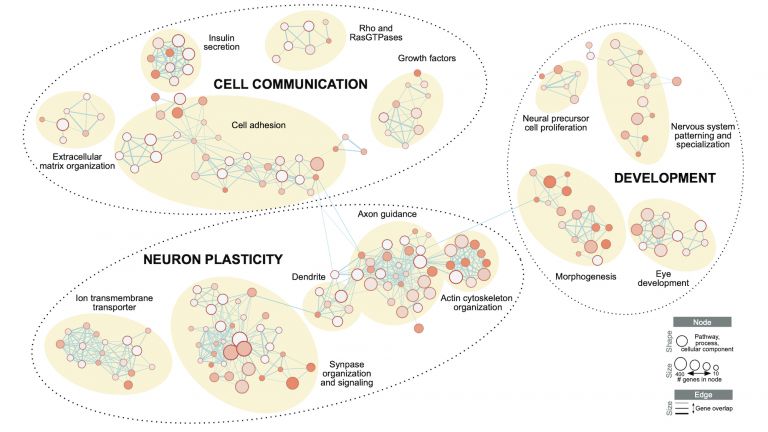

Das heranreifende Sprachvermögen der Kinder wird von Veränderungen im Gehirn begleitet. So zeigen charakteristische Wellenformen im EEG, so genannte ereigniskorrelierte Potenziale, wenn Kinder bestimmte Worte korrekt den zu ihnen passenden Bildern zuordnen (mit etwa einem Jahr) oder verlässlich auf inhaltlich oder grammatisch unsinnige Sätze reagieren (mit etwa drei Jahren). Auch bestimmte Verschaltungen im Gehirn entwickeln sich erst im Laufe des Spracherwerbs. Eine bei Erwachsenen stark ausgeprägte Verknüpfung zwischen Schläfenlappen und Broca-Areal zum Beispiel reift langsam in den ersten acht Lebensjahren. Erst wenn dieser Prozess abgeschlossen ist, können Kinder auf einem mit Erwachsenen annähernd vergleichbaren Niveau mit komplexer Grammatik umgehen (Das Netzwerk der Sprache).

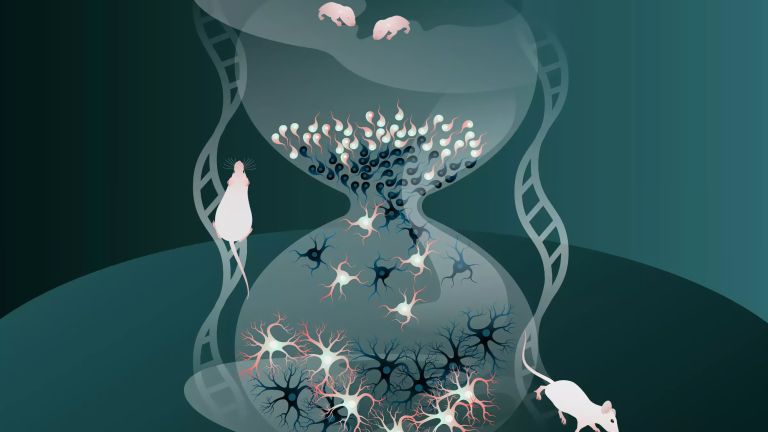

Bei Kindern mit einer so genannten spezifischen Spracherwerbsstörung, die trotz normaler Hörfähigkeit und Intelligenz Schwierigkeiten beim Erlernen von Sprache haben, laufen diese neurophysiologischen Entwicklungsprozesse verändert ab. Solche Störungen sind stark genetisch bedingt.

Broca-Areal

Broca-Areal/-/Broca´s area

Ein Areal des präfrontalen Cortex (Großhirnrinde), das sich meist in der linken Hemisphäre befindet. Maßgeblich an der motorischen Erzeugung von Sprache beteiligt. Erstmals beschrieben von dem französischen Neurologen Paul Pierre Broca im Jahr 1861.

Am Anfang steht das Keckern, das zittrige Quäken, mit dem sich Menschenkinder nach der Geburt erstmals stimmlich bemerkbar machen. Wenn die Kleinen im Alter von etwa zwei Jahren das Babydasein dann hinter sich lassen, beherrschen sie meist bereits über 50 Wörter, die sie zu einfachen Zwei-Wort-Sätzen zusammenpuzzeln können – in einer oder mehreren von weltweit ungefähr 6500 Sprachen.

Wie kindliche Lautäußerungen sich innerhalb weniger Monate vom universell erscheinenden Babygeräusch in polyglotter Fülle zum komplexen Kommunikationswerkzeug entfalten, fasziniert stolze Eltern auf der ganzen Welt. Ein Vater, der diesen Prozess besonders genau verfolgen wollte, ist Deb Roy vom Laboratory for Social Machines am Massachusetts Institute of Technology (MIT). Bereits vor der Geburt seines Sohnes verkabelte Roy sein Heim mit Mikrofonen und Videokameras an den Zimmerdecken und zeichnete ab dem ersten Tag im neuen Familienleben fast jede wache Minute auf – ein gigantisches, 90.000 Stunden dauerndes Homevideo. In einem viel beachteten TED-Talk zeigte Roy 2011, wie sich aus diesem „Speechome“ die Geburt einzelner Wörter herausschält. Er hat dokumentiert, wie beispielsweise das Wort „water“ über Monate hinweg aus dem Brabbellaut „gaga“ heranreift, und auch, in welchen Zimmern und im Gespräch mit welchen Betreuungspersonen sich dieser Prozess vollzog. Ob das Experiment wirklich neue Einsichten in den Prozess des Sprechenlernens enthüllt, bleibt abzuwarten; die Analyse des Datenwusts dauert an.

Es beginnt mit dem Zuhören

Glücklicherweise wissen wir dank einer Fülle anderer Studien auch so schon ganz gut Bescheid: Bereits im Mutterleib spitzt das Ungeborene die Ohren. Ab der 24. Schwangerschaftswoche reagieren Föten zum Beispiel mit Bewegungen oder veränderten Hirnströmen auf Töné und können schon wenig später zwischen verschiedenen Lauten unterscheiden. Selbst extrem junge Frühchen, deren cortikale Verschaltungen bei einer Geburt nach nur 29 Wochen noch sehr unreif sind, halten unterschiedliche Silben und männliche und weibliche Stimmen auseinander.

Gerade der Unterwasserakustik der Gebärmutter entschlüpft, bevorzugen Neugeborene schon zuverlässig die Muttersprache oder sogar konkrete Geschichten, die ihre Mütter ihnen während des letzten Schwangerschaftsdrittels wiederholt vorgelesen hatten.

Auch in der eigenen Artikulation hinterlässt das pränatal Gehörte von Anfang an Spuren. Das beim ersten Hinhören so ähnlich klingende Keckern der frisch entbundenen Erdenbürger entpuppt sich nämlich bei genauerer Analyse als schon kulturell eingefärbt. Französische Neugeborene setzten betonende Akzente konform mit ihrer Muttersprache eher am Ende ihrer Melodie, deutsche betonen den Anfang stärker. Mit einem Verständnis von Wörtern oder gar Sätzen haben diese ersten Sprachkeime allerdings noch nichts zu tun. Am Anfang lernt das Kind nur die Prosodie, den Klang der Sprache.

Im Laufe der ersten vier Monate ihres Lebens entwickeln Kinder ein beachtliches Gespür für vertraute Klänge. Jede Sprache ist zum Beispiel aus zehn bis 65 elementaren bedeutungsunterscheidenden Lauten oder Phonemen zusammengesetzt; im Deutschen sind es etwa 40. Die wachsende Vertrautheit mit den sprachtypischen Phonemen und ihren Klangfolgen ermöglicht es Babys zum Beispiel zunehmend, Musterverletzungen zu erkennen. Die eigenen Lautäußerungen stimmen sie derweil immer feiner auf das in der Umgebung gehörte ab und produzieren bald erste Silben, die sie schon kurze Zeit später zu typischen Lall-Monologen wiederholend aneinanderreihen.

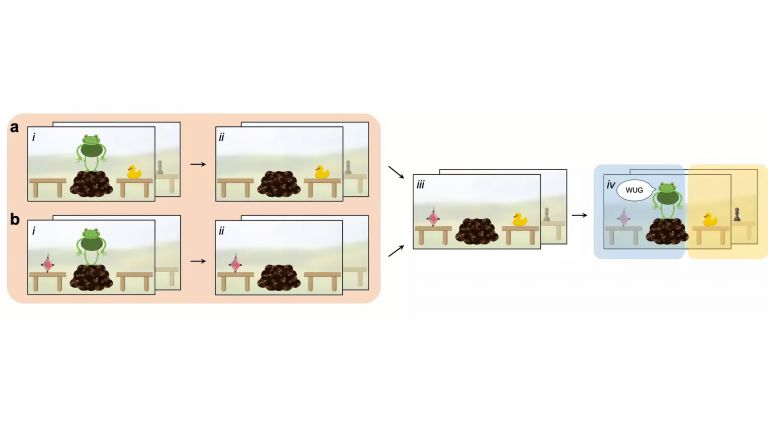

Das Auge hört mit

Diese ersten Stufen des Spracherwerbs erfolgen keineswegs nur mit Ohr und Stimme; auch das Auge hört mit. Im ersten halben Lebensjahr zeigen Babys einen scharfen Blick für Fremdsprachen. Sie merken sofort, wenn der Sprecher in einem stumm geschalteten Video die Sprache wechselt. Sind die Eltern gehörlos und sprechen ihre Kinder nur mit Zeichensprache an, lernen diese bald, selbst mit den Händen zu „babbeln“ – im Gegensatz zu Altersgenossen mit normal hörenden Eltern fuchteln sie wesentlich rhythmischer und bestimmter.

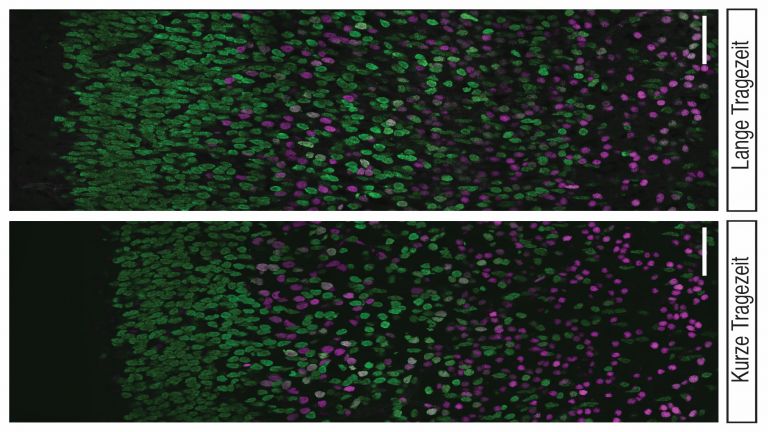

Auch im weiteren Verlauf der Entwicklung zeigt sich, wie eng die angeborene Sensitivität der Babys für kommunikative Signale und die tatsächlich von ihrer Umgebung vermittelten Reizen zusammenwirken (vgl. Artikel 2.9.5). Hört ein Baby zum Beispiel nur eine Sprache, erlischt sein Gespür für den Sprachwechsel beim Lippenlesen im zweiten Halbjahr. Zweisprachig aufwachsende Kinder hingegen, für die es verständlicherweise wichtig bleibt, Sprachen auseinander halten zu können(‣Wie behalten mehrsprachig aufwachsende Babys den Überblick?), behalten diese Fähigkeit vorerst. Japanische Kinder, die einsprachig aufwachsen, erkennen zudem mit zehn Monaten keinen Unterschied mehr zwischen „r“ und „l“, obwohl sie diese Laute im Alter von sieben Monaten noch gut auseinander halten können.

Ohr

Ohr/Auris/ear

Das Ohr ist nicht nur das Organ des Hörens, sondern auch des Gleichgewichts. Unterschieden werden das äußere Ohr mit Ohrmuschel und äußerem Gehörgang, das Mittelohr mit Trommelfell und den Gehörknöchelchen sowie das eigentliche Hör– und Gleichgewichtsorgan, das Innenohr mit der Gehörschnecke (Cochlea) und den Bogengängen.

Auge

Augapfel/Bulbus oculi/eye bulb

Das Auge ist das Sinnesorgan zur Wahrnehmung von Lichtreizen – von elektromagnetischer Strahlung eines bestimmten Frequenzbereiches. Das für den Menschen sichtbare Licht liegt im Bereich zwischen 380 und 780 Nanometer.

Empfohlene Artikel

Das erste Wort

Die zunehmende Spezialisierung wird belohnt. Mit ungefähr neun Monaten entwickeln Kinder ein semantisches Verständnis und beginnen, verlässlich auch die inhaltliche Bedeutung von Worten zu begreifen. Nur wenige Wochen später erreichen die meisten den magischen Moment: Sie sprechen ihr erstes Wort. Bezeichnender Weise sind die ersten Worte Menschen und Objekte aus der nächsten Umgebung. Also „Papa“ und „Mama“, „Ball“ oder Teddy-„Bär“. Abstrakte Begriffe wie „frei“ oder „Idee“ übernimmt ein Kind erst sehr viel später in den Wortschatz.

Spätestens ab dem ersten Wort kennt die Kettenreaktion des kindlich-erwachsenen Sprachlernduetts kein Halten mehr.

Sobald das erste Wort gefallen ist oder auch nur mit viel elterlicher Fantasie herausgehört wurde, vollzieht sich ein merkwürdiger Wandel in der Art und Weise, in der Gesprächspartner mit dem Kind sprechen. Sie üben sich in der gerne verlachten – weil dümmlich klingenden – „Babysprache“, mit besonders langsamer und betonter Aussprache und vereinfachten Satz– und Wortkonstruktionen.

Forscher vermuten, dass die so erhöhte Verständlichkeit Babys beim Feintuning des eigenen Sprachgebrauchs hilft. Deb Roy beispielsweise beobachtete, dass die Bedächtigkeit, mit der Erwachsene sprachen, bei jedem neu erlernten Wort seines Sohnes vorübergehend einen neuen Höhepunkt erreichte. „Wir restrukturierten unbewusst unsere eigene Sprache, um ihm bei der Geburt eines Wortes zu begegnen und ihn sanft zu komplexerer Sprache zu bringen“, sagt er.

Wie viel die Interaktion mit erwachsenen Gesprächspartnern ausmacht, zeigt sich in der nächsten Lernphase im zweiten bis vierten Lebensjahr, wenn Kinder ihr frisch erworbenes Sprachvermögen mithilfe eines rapide expandierenden Wortschatzes und einem immer besseren Verständnis für Syntax ausbauen. Verwenden knapp Zweijährige noch überwiegend Alltagswörter in einfachen Zweiwortsätzen, können Dreijährige bereits grammatisch unterschiedliche Worttypen wie Verben, Substantive, Adjektive und Präpositionen korrekt zusammen gebrauchen. Gleichzeitig werden nun Unterschiede messbar, die wenig mit eventuell genetisch bedingten Sprachverzögerungen zu tun haben (siehe Infokasten), dafür aber umso mehr mit dem, was die Kleinkinder im Alltag hören.

Vorbilder im Sprechen

In einer amerikanischen Studie hatten Kinder aus sozial schwachen Familien im Alter von drei Jahren 30 Millionen weniger Wörter gehört als ihre Altersgenossen aus privilegierteren Familien. Die Lücke machte sich auch im Grundschulalter noch in Form schwächerer sprachlicher Leistungen bemerkbar. Selbst kleine Unterschiede können viel ausmachen. Ein Vergleich ähnlich gebildeter Familien, in denen alle Mütter verlässlich viel mit ihren Kindern redeten, zeigte, dass Kinder mit wortkargen Vätern mit drei Jahren weniger gut sprechen konnten als Kinder, deren Väter schon früh wortreich mit ihnen geschwatzt hatten.

Eltern, deren Sprösslinge sich mit dem Sprechen Zeit lassen, brauchen sich dennoch nicht gleich zu sorgen. Es gibt sprachliche Spätzünder, die den Rückstand häufig um den dritten Geburtstag herum aufholen. Und für Kinder mit tatsächlichem Förderbedarf existieren vielfältige Angebote. Sie alle teilen sich mit der ganz normalen Sprachförderung im Familienalltag eine Gemeinsamkeit: Damit ein Kind (besser) sprechen lernen kann, muss man aktiv mit ihm sprechen. Das bloße Parken vor Videos oder Hörspielen reicht nicht aus.

Technikfans können sie dennoch auf einige Innovationen freuen, die Kinder beim Sprechen lernen helfen sollen. Ansätze wie das kürzlich in Korea getestete TalkBetter-System oder das Providence Talks System in den USA setzen darauf, Eltern-Kind-Gespräche über am Körper getragene Mikrophone aufzeichnen, um Eltern mit Hinweisen zu versorgen, wie sie die Kommunikation mit dem Nachwuchs sprachförderlich verbessern können. Und wem das nicht reicht, der kann auf die nächste Robotergeneration hoffen: In einem zweimonatigen Modellversuch konnten kuschelige und sozial feinfühlig agierenden „DragonBots“ erste Erfolge dabei verzeichnen, das Vokabular und allgemeine Sprachverständnis von Kindergartenkindern in interaktiven Geschichtenerzähl-Spielen aufzupeppen.